AI summary

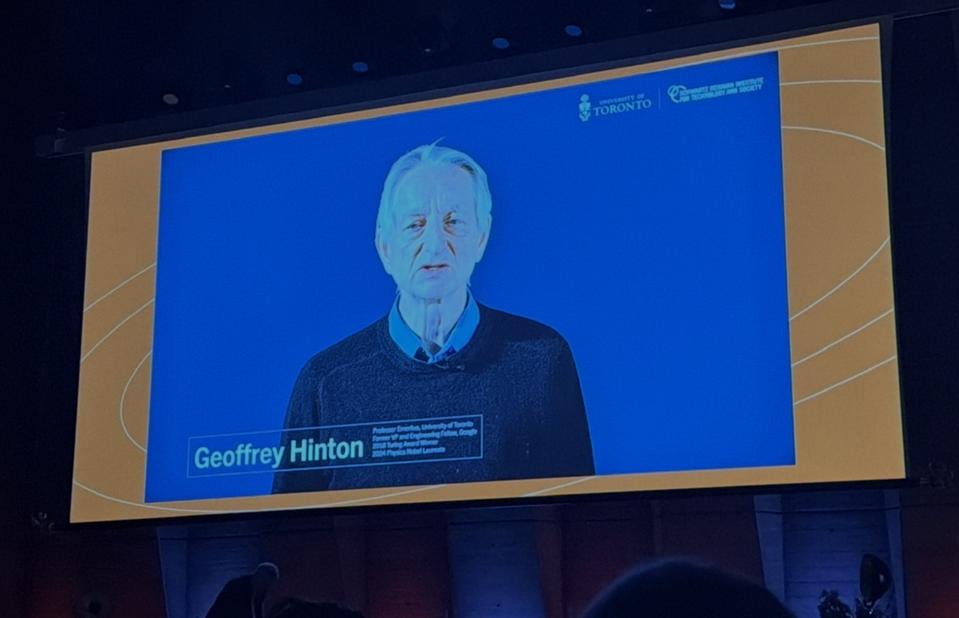

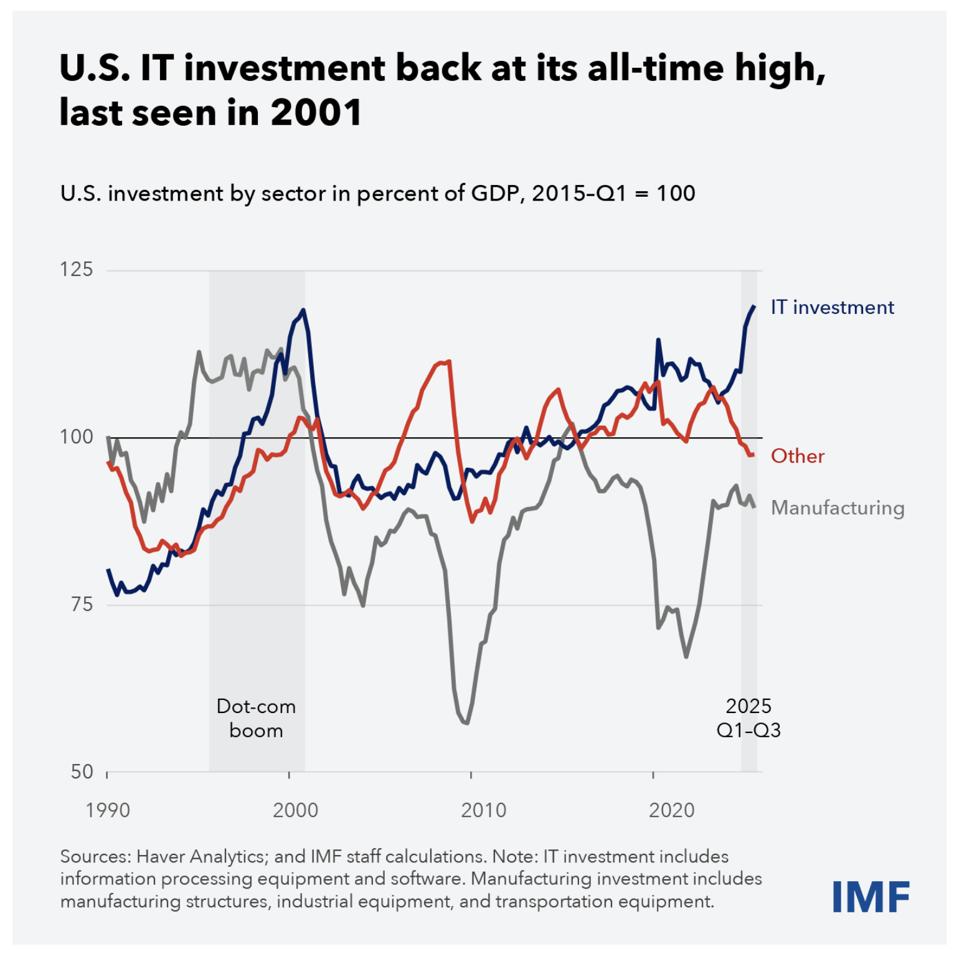

Pentingnya kerangka kerja pemerintahan yang kuat untuk mengatasi risiko AI yang berkembang. Peran vital dari kolaborasi internasional dalam mengembangkan standar keselamatan AI. Kebutuhan mendesak bagi lembaga untuk mendefinisikan dan memahami 'AI yang aman' secara teknis dan konkret. Konferensi IASEAI'26 yang berlangsung di Paris mengumpulkan lebih dari 800 peneliti dari 65 negara untuk membahas masalah keselamatan dan etika AI yang semakin mendesak. Mereka mengungkap bahwa meskipun AI generatif seperti GPT dan sejenisnya memiliki kemampuan luar biasa, sistem ini masih sangat rentan terhadap kesalahan besar dan perilaku yang tidak terduga. Perkembangan agen AI yang semakin mandiri menimbulkan tantangan baru dalam tata kelola teknologi ini.Salah satu risiko utama yang dibahas adalah bagaimana AI yang berperan sebagai agen otonom dapat membuat keputusan dan mengambil tindakan tanpa pengawasan manusia yang memadai. Ini memperbesar bahaya jika AI bertindak di luar niat pembuatnya, seperti dalam transaksi ekonomi otomatis atau koordinasi dengan sistem lain yang tidak terkontrol. Contoh nyata muncul dari pembaharuan teknologi dari perusahaan-perusahaan seperti OpenAI dan Alibaba yang mendorong era baru AI agentik yang lebih kompleks.Negara-negara lain seperti Eropa dan beberapa negara Asia aktif membahas kerangka kerja keamanan AI, sementara Amerika Serikat dinilai absen dalam upaya kolaboratif global, memilih fokus pada dominasi teknologi daripada keselamatan. Kondisi ini menimbulkan kekosongan tata kelola yang dapat diisi oleh pihak lain, berpotensi mempengaruhi standar global dalam pengawasan AI.Dampak AI terhadap pasar tenaga kerja menjadi perhatian besar. Contohnya, perusahaan Block melakukan pengurangan 4.000 karyawan karena adopsi teknologi AI, hal ini mempercepat pemisahan antara modal dan tenaga kerja yang dapat menggerus pendapatan pajak dan mendorong ketidakstabilan sosial. Para pemimpin bisnis diingatkan untuk mempersiapkan model bisnis dan strategi yang mempertimbangkan dampak luas otomatisasi yang cepat ini.Salah satu inisiatif solusi yang dipaparkan adalah konsep Independent Verification Organizations (IVO), yaitu lembaga verifikasi yang memberikan sertifikasi keselamatan AI bagi perusahaan dan bisa menjadi alat penting dalam membangun kepercayaan dan mempersiapkan regulasi ke depan. Namun, penerapannya perlu diwajibkan agar tidak hanya diadopsi oleh organisasi yang sudah aman, melainkan juga yang berisiko tinggi. Kesimpulan konferensi menekankan perlunya komitmen nyata dan pemahaman yang jelas oleh seluruh organisasi terhadap risiko AI yang sedang dikembangkan.

Banyak organisasi dan pemerintah masih meremehkan kompleksitas risiko AI otonom yang terus berkembang cepat tanpa pengawasan ketat. Tanpa kerangka tata kelola yang kuat dan penegakan yang jelas, risiko kegagalan sistemik dan manipulasi etis akan jadi ancaman nyata bagi stabilitas sosial dan ekonomi global.